【AI 기술 발전과 윤리 논쟁: 미래를 위한 균형 찾기】

이 글에서 배울 내용:

- 최신 AI 기술 발전 현황과 주요 분야 소개

- AI 윤리 문제의 핵심 쟁점과 사회적 영향

- 윤리적 AI 개발을 위한 규제와 가이드라인 동향

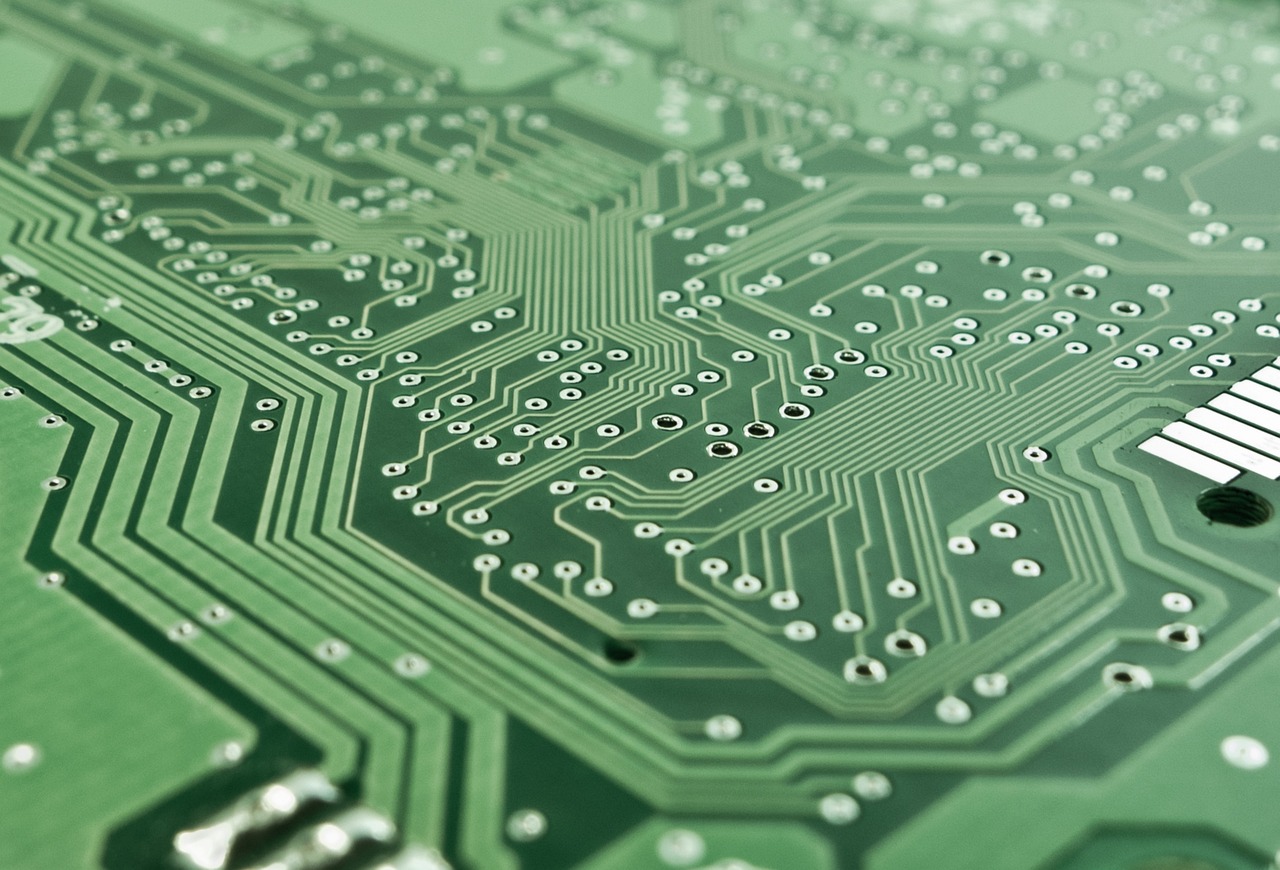

★ AI 기술의 현재와 미래 전망 관련 이미지

★ AI 기술의 현재와 미래 전망

인공지능(AI)은 최근 급속히 발전하며 산업 전반에 혁신을 가져오고 있습니다. 자연어 처리, 이미지 인식, 자율주행 자동차 등 다양한 분야에서 활용도가 높아지고 있습니다. 특히 머신러닝과 딥러닝을 기반으로 한 AI는 데이터 분석과 예측 능력을 비약적으로 향상시키고 있습니다.

✓ AI 기술 주요 분야

- 자연어 처리 (NLP): 챗봇, 번역, 음성 인식 등

- 컴퓨터 비전: 얼굴 인식, 의료 영상 분석

- 자율 시스템: 자율주행차, 드론

- 로봇공학: 공장 자동화, 서비스 로봇

★ AI 윤리 논쟁의 핵심 이슈 관련 이미지

★ AI 윤리 논쟁의 핵심 이슈

AI 기술의 발전과 함께 다양한 윤리적 문제가 제기되고 있습니다. 공정성, 책임 소재, 개인정보 보호 등이 대표적인 쟁점입니다. AI 시스템이 편향된 데이터를 학습하면 편견을 강화할 위험이 있으며, 결정 과정 불투명성은 신뢰 문제로 이어집니다.

✓ 주요 윤리 문제

- 편향과 차별: 특정 집단에 불리한 결과 초래 가능

- 책임 소재 불명확성: AI 결정에 대한 법적 책임 문제

- 개인정보 보호: 데이터 수집과 활용의 투명성 필요

- 자동화에 따른 일자리 영향: 노동 시장 변화와 사회 안전망

★ 윤리적 AI 개발을 위한 정책과 가이드라인 관련 이미지

★ 윤리적 AI 개발을 위한 정책과 가이드라인

여러 국가와 기관에서는 AI 윤리 규범과 법적 틀을 마련하고 있습니다. 책임 있는 AI 개발과 투명성 확보, 인간 중심 설계가 강조됩니다. AI가 사회적 가치를 해치지 않도록 국제 협력도 활발히 진행 중입니다.

✓ 주요 정책 동향

- EU AI 법안: 위험도 기반 규제 체계 도입

- OECD 원칙: 공정성, 투명성, 책임성 강조

- 기업 윤리 가이드라인: 자체 윤리 위원회 운영과 교육

▷ 윤리적 AI 기술 적용 사례

의료 AI에서 환자 데이터 보호와 공정한 진단, 자율주행차에서는 안전 기준 마련이 대표적입니다. 이러한 사례는 윤리 기준이 실제 기술 발전과 어떻게 조화를 이루는지를 보여줍니다.

AI 기술은 사회적 가치와 윤리적 기준 위에서 개발되어야만 지속 가능한 발전과 신뢰를 확보할 수 있습니다.

요약

- AI는 다양한 분야에서 혁신을 주도하며 빠르게 발전 중입니다.

- 윤리 문제는 AI 공정성, 책임, 개인정보 보호가 핵심입니다.

- 글로벌 규제와 가이드라인이 윤리적 AI 개발을 촉진합니다.

- 윤리적 고려는 기술의 신뢰성과 사회적 수용성 확보에 필수적입니다.

- 지속 가능한 AI 발전을 위해 기술과 윤리의 균형이 필요합니다.

관련 해시태그:

#인공지능윤리

#머신러닝

#컴퓨터비전

#데이터윤리

#자동화

#자율주행

#AI규제

#윤리적기술

#기술혁신

![추석선물 코오롱제약 락토메디 생유산균 30포 [원산지:국산(경기도 고양시 일산서구)]](https://bicorn.co.kr/album/marketing_promotion/6815b19cc2f23_product_1_1746252188_p1.png)

No responses yet